Muchas gracias!!! 😊😊😊

26.06.2025 11:11 — 👍 0 🔁 0 💬 0 📌 0Jacin

@soyjacinto.bsky.social

PhD. Sociología y Antropología

@soyjacinto.bsky.social

PhD. Sociología y Antropología

Muchas gracias!!! 😊😊😊

26.06.2025 11:11 — 👍 0 🔁 0 💬 0 📌 0Os dejamos por aquí el hilo seleccionado en la @ucm.es para la fase nacional de #HiloTesis

¡Enhorabuena a Jacinto Gutiérrez! 👏

🖼️Ilustración de Delhy Tejero, "Crónica"(1934). Imagen procedente de la Biblioteca Nacional de España

🤳Antes de Instagram ya hubo redes sociales: cartas, tertulias, revistas…

Las artistas de la Edad de Plata (1902-1939) fueron creadoras de cultura y memoria.

Mi tesis estudia sus conexiones en este periodo.

🧵Vamos con #HiloTesis

@crueuniversidades.bsky.social @filarramendi.bsky.social @uclm.es

18/18. Los deepfakes sexuales no son una broma. Causan daños reales a las víctimas. Llámalo por su nombre: es violencia sexual.

Si te interesa seguir la investigación, dejo aquí mi ORCID: 0000-0003-4465-7867

Mi #HiloTesis acaba aquí, pero la tesis y esta lucha continúan✊

@filarramendi.bsky.social

17/18. ¿Qué más se puede hacer?

📚 Preservar pruebas digitales con eGarante

📞 Llama gratis al 017 (INCIBE), 016 o la línea de @fembloc.bsky.social

📝Solicita la retirada de contenidos en #AEPD y Google

✋🏻Denunciar la publicación en redes y pedir colaboración para bajar el contenido

16/18.

❌ No compartas si sospechas que es material deepfake. El consentimiento siempre va primero

📣 Si decides avisar a la persona o a su entorno, hazlo con cuidado y ofrece ideas para actuar

👂 Escucha. Cada persona es un mundo, no tomes decisiones sin consultar

🤝Acompaña sin culpabilizar

15/18. Cuando sospeches que estés ante un deepfake sexual, pregúntate: ¿la persona que aparece en la imagen ha dado su consentimiento para usarla? ¿Hace o dice algo ilícito o que pueda dañarla? Aquí van algunas claves para saber cómo actuar en esos casos👇

05.06.2025 08:59 — 👍 0 🔁 0 💬 1 📌 0

14/18. 🤓☝️ Como explican en este artículo de @elsaltodiario.com, el debate sobre la responsabilidad de las plataformas digitales es urgente.

🌐 Internet está bastante regulado

❗️❗️ sin embargo, el problema es que muchas plataformas no cumplen ni responden a tiempo

(acortar.link/5BLXl4)

13/18. Por suerte, se combaten estas agresiones desde distintos ámbitos:

🌍 Campañas como #NotYourPorn o #MyImageMyChoice

💜 Colectivas como @fembloc.bsky.social y Fundación Iniciativa Social

Además, en 2025 se aprobó un anteproyecto de ley para regular los deepfakes sexuales ⚖️

12/18. Todo lo anterior se basa en una cultura patriarcal que trivializa la violencia sexual digital. Como es “solo una imagen”, se percibe como menos real. Pero el daño sí que lo es. Insomnio, ansiedad o menor rendimiento académico son algunas de las consecuencias que causa en las víctimas

05.06.2025 08:59 — 👍 0 🔁 0 💬 1 📌 0

11/18.

🎯Existe un mercado lucrativo donde es posible “desnudar a cualquier chica que desees” o “crear a la chica de tus sueños”. Apps y bots diseñados para desnudar exclusivamente a mujeres, lo que revela la cultura digital misógina que sostiene este "negocio" ilícito. La tecnología no es neutral🙅♂️

10/18. Algunos resultados preliminares📜:

🎯Según la encuesta, las chicas sufren más la alteración digital sexual de imágenes, y ellos la alteración no sexual.

🎯En mi observación he podido constatar que los varones desnudan a chicas de su círculo cercano (familiares, amigas, etc.)

9/18. Mediante esta aproximación busco entender cómo se justifica esta violencia y cómo restaurar el daño desde las voces de quienes lo sufren. Como dice @laiaserra.bsky.social, la reparación tiene que ser un pilar básico de la justicia feminista

(acortar.link/DsiIfp)

8/18. Mi metodología de investigación combina:

📊Análisis de encuesta

👀Observación en plataformas digitales

💬Entrevistas con expertas y jóvenes adolescentes chicos y chicas

🔎Todo bajo la supervisión del Comité de Ética de la @ucm.es y con enfoque sensible al trauma

7/18. Una encuesta de @fadjuventud.bsky.social reveló que 1 de cada 10 jóvenes ha creado imágenes sexuales con IA de personas cercanas. Las víctimas suelen enterarse por chantajes, acciones realizadas por los agresores, de casualidad o mediante la ayuda de su entorno (acortar.link/aa0GHP)

05.06.2025 08:59 — 👍 1 🔁 1 💬 1 📌 0

Imagen de una persona atrapada en un teléfono móvil.

6/18. Las creaciones con IA que examino en mi tesis son agresiones en las que se sustraen imágenes, se edita y sexualiza el cuerpo de alguien sin su permiso. Desaparecen el consentimiento y la autonomía, y la víctima se convierte en un objeto de consumo. Esto se denomina violencia sexual digital

05.06.2025 08:59 — 👍 1 🔁 0 💬 1 📌 0

5/18. En Almendralejo decenas de chicas de un instituto fueron desnudadas y extorsionadas por sus compañeros. “Mi hija me enseñó una conversación con un chico en la que le pide dinero, ella dice que no y le manda su supuesta imagen desnuda”, de @martaborraz.bsky.social (acortar.link/KSi1O9)

05.06.2025 08:59 — 👍 0 🔁 0 💬 1 📌 0

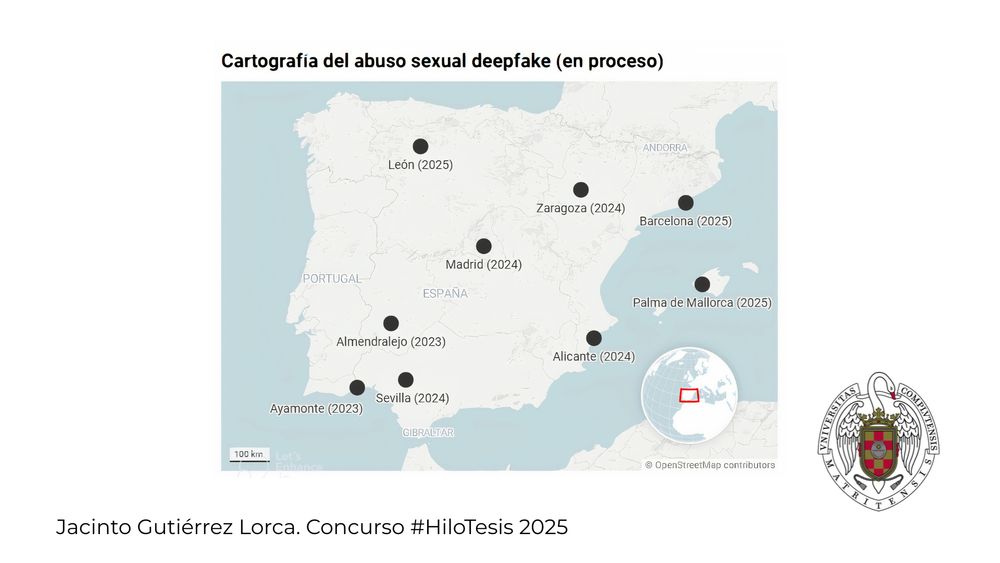

Cartografía del abuso sexual deepfake en el Estado español. Material asociado a la tesis doctoral de Jacinto Gutiérrez Lorca en la UCM.

4/18. Lamentablemente, esta nueva forma de violencia se está propagando rápidamente. León, Sevilla, Madrid, Zaragoza, Barcelona o Alicante son algunas de las ciudades donde se han registrado abusos de esta naturaleza, pero hay más.

Veamos un caso que tuvo una gran repercusión mediática en 2023 👇

3/18. En mi tesis investigo cómo se crean y difunden imágenes sexuales alteradas con IA de chicas jóvenes, sin su consentimiento, en España. Me pregunto:

🤔¿Cómo se producen estas agresiones?

🤔¿Qué daños causan?

🤔¿Cómo prevenirlas y repararlas?

2/18. Sé que lo importante aquí no soy yo, sino las personas afectadas, pero creo que es útil dar algo de contexto para que me conozcáis. Me llamo Jacinto, soy doctorando en la @ucm.es, en el programa de Sociología y Antropología. @crueuniversidades.bsky.social @ucm.es @ucccomplutense.bsky.social

05.06.2025 08:59 — 👍 1 🔁 1 💬 1 📌 0

Portada de la tesis doctoral de Jacinto Gutiérrez Lorca en la UCM.

1/18. “Me puse muy nerviosa, me dio un ataque de ansiedad. Lo están pasando verdaderamente mal.” Así relataba una madre a @martaborraz.bsky.social en @eldiario.es en 2023 cómo su hija fue víctima de un ‘deepfake sexual’, una imagen alterada sexualizada creada con IA. ¡Dentro #HiloTesis! ⬇️🧵

05.06.2025 08:59 — 👍 6 🔁 4 💬 2 📌 1